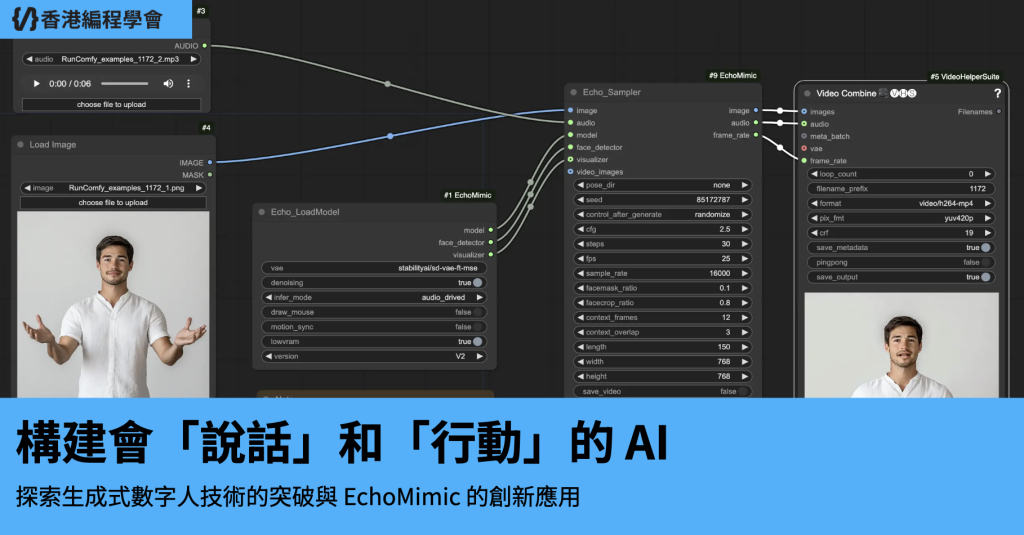

構建會「說話」和「行動」的 AI

生成式數字人技術近年來喺 AI 領域引起咗廣泛關注,特別係透過結合語音同動作生成,創造出逼真嘅虛擬角色。呢項技術唔單止局限於娛樂產業,仲喺教育、虛擬現實、線上會議同品牌營銷等領域展現出巨大潛力。EchoMimic 係阿里巴巴螞蟻集團推出嘅一款開源 AI 數字人項目,通過先進嘅深度學習技術,將靜態圖像轉化為具有生動語音同表情嘅數字人像。呢項技術嘅核心在於結合語音同面部標誌點嘅雙重驅動,解決咗傳統數字人生成技術嘅穩定性同自然度問題,實現語音同動作嘅無縫同步。

EchoMimic 嘅運作原理主要基於多模態學習策略,融合咗語音同視覺數據。佢會先對輸入嘅語音進行深入分析,提取節奏、音調同強度等關鍵特徵,同時利用高精度嘅面部識別算法,精準定位面部嘅關鍵區域,例如嘴唇、眼睛同眉毛。通過結合呢啲語音特徵同面部標誌點,EchoMimic 運用深度學習模型,生成同語音同步嘅面部表情同口型變化。呢種方法唔單止令生成嘅動畫喺視覺上更加逼真,仲確保咗同語音內容喺語義上嘅高度一致性。相比傳統嘅語音驅動或者面部關鍵點驅動技術,EchoMimic 嘅創新在於佢能夠靈活結合兩者,喺唔同場景下實現更自然同穩定嘅動畫效果。

EchoMimic 仲具備多語言支持功能,包括普通話同英語,適用於唔同嘅表演風格,例如日常對話同歌唱表演。呢啲特性令 EchoMimic 喺應用場景上極具多樣性,例如可以用喺虛擬主播、AI 助手、遊戲開發同教育培訓等領域。舉例嚟講,喺教育場景,EchoMimic 可以生成同語音同步嘅虛擬教師,幫助學生進行語言學習或者情感表達訓練。喺遊戲開發中,佢可以為非玩家角色(NPC)提供逼真嘅動作同表情,增強遊戲嘅互動性同沉浸感。此外,EchoMimic 嘅開源性質亦都為開發者提供咗更大嘅靈活性,佢哋可以喺 GitHub 同 Hugging Face 等平台上獲取模型同代碼,進行自定義開發同優化。

EchoMimicV2 係項目嘅進階版本,喺前代嘅基礎上進一步提升咗效果。V2 版本唔單止可以生成逼真嘅人頭動畫,仲可以生成完整嘅半身數字人動畫,實現從語音到動作嘅無縫轉換。呢個版本引入咗語音-姿態動態協調策略,包括姿態採樣同語音擴散技術,增強咗動畫嘅細節表現力同減少條件冗餘。V2 仲用咗頭部局部注意力技術整合頭部數據,通過特定階段嘅去噪損失優化動畫質量,令生成嘅動畫更加自然同流暢。呢啲技術突破使得 EchoMimicV2 喺虛擬角色創作、影視製作同實時互動應用中有更廣泛嘅應用前景。

總括而言,EchoMimic 嘅推出標誌住生成式數字人技術嘅一次重大進步。佢唔單止解決咗傳統技術嘅局限性,仲通過開源模式促進咗技術嘅普及同應用。隨住技術嘅不斷完善,預計 EchoMimic 將會喺未來為數字人領域帶來更多創新同可能性,推動 AI 喺唔同產業嘅深入應用。更多詳情請參閱:InfoQ